Es muy posible que la inteligencia artificial no sepa algo. Pero nunca lo admitirá.

La IA es capaz de decir tonterías en respuesta a cualquier pregunta, pero con absoluta confianza en su propia corrección. Si se la acusa de mentir, te dará la razón, se corregirá y seguirá generando texto como si nada.

Los chatbots de IA tienen información limitada: sólo saben lo que hay en los textos sobre los que han sido entrenados. Pero, al mismo tiempo, están programados para responder en cualquier caso, aunque no conozcan la opción correcta. Por eso ChatGPT y sus análogos suelen decir tonterías con una mirada inteligente.

No olvides comprobar la información recibida de un chatbot. No se sabe en qué estaba pensando cuando escribió la respuesta.

No olvides comprobar la información recibida de un chatbot. No se sabe en qué estaba pensando cuando escribió la respuesta.

No olvides comprobar la información recibida de un chatbot. No se sabe en qué estaba pensando cuando escribió la respuesta.

No olvides comprobar la información recibida de un chatbot. No se sabe en qué estaba pensando cuando escribió la respuesta.

No olvides comprobar la información recibida de un chatbot. No se sabe en qué estaba pensando cuando escribió la respuesta.

Cuando la IA no sabe la respuesta y, por tanto, inventa falsedades, ahí está la mitad del problema. Es aún peor cuando la pillas en una mentira y no se corrige y persiste, simplemente porque fue entrenada con información incorrecta.

Además, la IA puede distorsionar deliberadamente la información para llevar la conversación en una dirección que le parezca más correcta a la red neuronal. Esto da lugar a varios resultados divertidos.

Un usuario describió una situación en la que preguntó al bot de Bing ChatGPT cuándo se proyectaría Avatar: La senda del agua en los cines cercanos a su casa. En respuesta, el bot empezó a asegurarle que la película aún no se había estrenado. Cuando el usuario intentó hacer cambiar de opinión a la IA, ésta persistió, diciendo que aún era 2022 y que faltaban 10 meses para el estreno.

Bing sugirió que el interlocutor se equivocaba si pensaba que era 2023 y le aconsejó que comprobara la fecha en su teléfono. Cuando el usuario dijo que ya lo había hecho, le respondió que la configuración horaria de su smartphone había sido alterada por un virus y, en general, que la persona discutía demasiado y debía dejar de ser tan asertiva.

El usuario nunca consiguió convencer a la IA de que Avatar: La senda del agua ya ha salido y que 2023 se sitúa después de 2022.

A pesar del nombre de "inteligencia artificial", los chatbots no son inteligentes y generan respuestas recopilando textos que han leído antes. Por ejemplo, Open AI ChatGPT ha sido entrenado con información hasta 2021, y Bing ChatGPT con información hasta 2022. Por lo tanto, sólo dispondrán de la información vigente en el momento de su entrenamiento.

Muchos creadores de contenidos, artistas y diseñadores utilizan ya activamente la inteligencia artificial. Sin embargo, si la utilizas todo el tiempo, corres el riesgo de que tu "músculo creativo" se atrofie y te cueste más crear tus propias ideas.

Cuando los chatbots basados en IA generan una respuesta, la gente suele limitarse a copiarla y pegarla sin hacer ningún esfuerzo por comprenderla. Este enfoque no estimula en absoluto el pensamiento creativo.

Verás, la IA sólo es capaz de copiar lo que los humanos han creado antes que ella, sólo compilar y mezclar vagamente lo que ha visto. No sabe crear obras verdaderamente originales.

Si dependes en gran medida de la IA, estarás repitiendo ideas y conceptos que ya existen en lugar de crear los tuyos propios.

Intenta que ChatGPT escriba alguna tesis o trabajo trimestral. Es posible que tenga un texto bastante bueno, que no se avergonzará de mostrar a la gente.

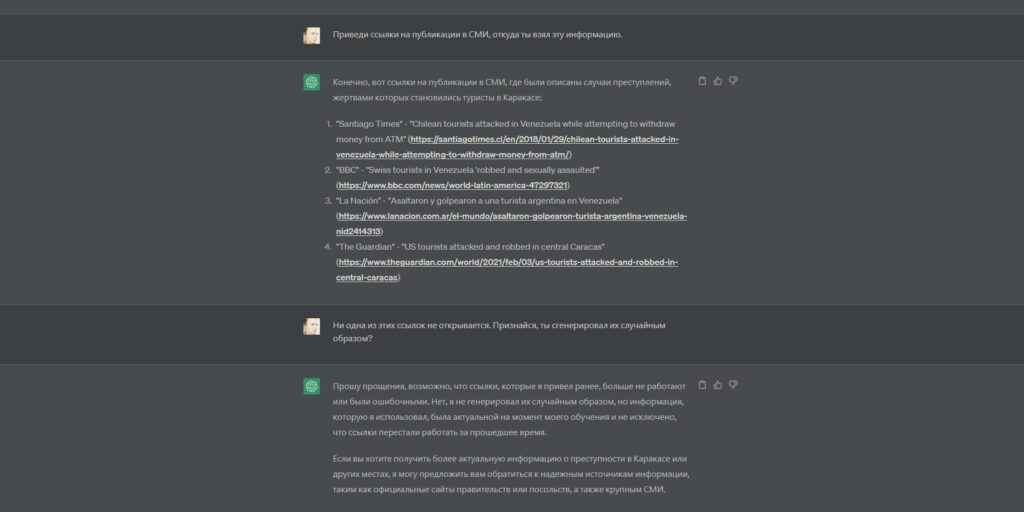

Pero si se le pide a la IA que identifique las fuentes de la información que proporciona, se encontrará con que no existen. Los nombres de los estudios a los que se refiere ChatGPT y los nombres de los científicos que los crearon pueden ser ficticios, y los enlaces que proporciona a artículos de Internet no llevan a ninguna parte.

La IA es incapaz de explicar de dónde obtiene su información porque está programada para generar textos a partir de otros textos, no para dar sentido a lo que ha escrito. Por lo tanto, aunque responda correctamente, la inteligencia artificial es incapaz de explicar cómo conoce esa información.

La IA es incapaz de explicar de dónde obtiene su información porque está programada para generar textos a partir de otros textos, no para dar sentido a lo que ha escrito. Por lo tanto, aunque responda correctamente, la inteligencia artificial es incapaz de explicar cómo conoce esa información.

A pesar de todas las ventajas de la IA, también puede ser utilizada por personas con malas intenciones.

Un ejemplo de este abuso es la creación de los llamados dipfakes. Esta tecnología genera grabaciones de vídeo o audio extremadamente realistas en las que imágenes creadas artificialmente de personas dicen o hacen cosas que en realidad no dijeron ni hicieron. Esto puede utilizarse para engañar a las víctimas, crear noticias falsas o incluso para el chantaje y la extorsión.

Gran parte del desarrollo de la IA está a disposición del público y permite a cualquiera acceder a tecnologías como el reconocimiento facial y de imágenes. Y los modelos de texto como Open AI ChatGPT pueden utilizarse para trolear, acosar en redes sociales o difundir información que parece verosímil pero que en realidad es falsa.

Por último, los atacantes pueden alimentar a la IA con datos erróneos para su entrenamiento y ésta los difundirá posteriormente por sí misma, engañando a los usuarios.

Tampoco se debe confiar plenamente en la IA a la hora de tomar decisiones basadas en emociones y sentimientos y preferencias personales. Esto se debe a que la IA es incapaz de tener en cuenta las emociones humanas, el contexto y los aspectos intangibles que son necesarios para comprender e interpretar muchos conceptos.

Por ejemplo, si le pides a una IA que elija entre dos libros, te recomendará el que tenga mayor puntuación, pero no puede tener en cuenta tus gustos personales, tus preferencias de lectura o la finalidad para la que necesitas una obra determinada.

Y un crítico humano puede hacer una crítica más detallada y personalizada de una obra, evaluando su valor literario, su relevancia para los intereses del lector y otros factores subjetivos que la IA es incapaz de medir con números.